NVIDIA GPU-Optimized AMI로 EC2 인스턴스 구성

NVIDIA GPU-Optimized AMI로 EC2 인스턴스 구성

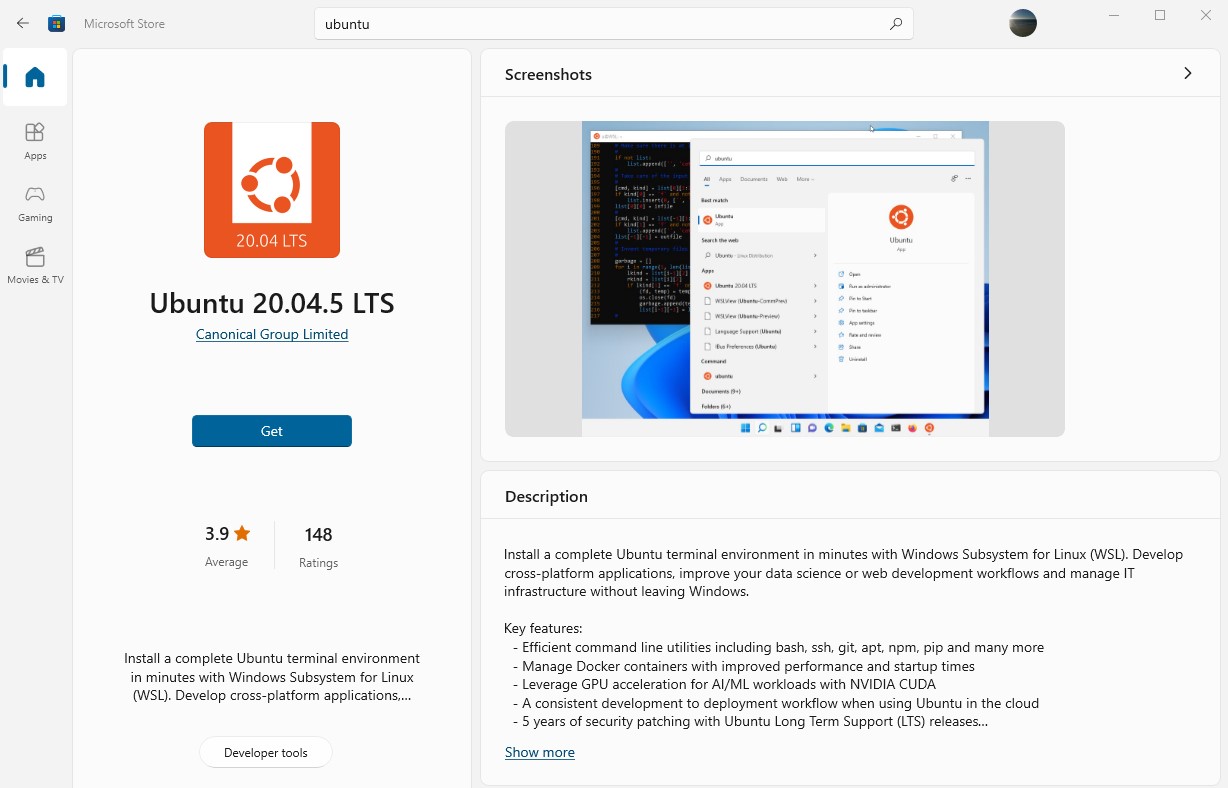

Windows에서 TRT 컨테이너를 실행하려는 경우 Anaconda 외에 선택할 수 있는 방법으로 WSL2가 있습니다. Windows Subsystem for Linux는 Windows 10 이상 환경에서 터미널을 통해 Ubuntu를 비동기적으로 실행할 수 있게 합니다. Microsoft Store에서 Ubuntu 20.04.5를 무료로 찾아 다운로드할 수 있습니다. 설치 후에는 Windows 검색창에 Ubuntu를 입력하여 WSL2를 실행하세요.

.png?alt=media)

--env NUM_WORKERS=[원하는 num_workers]